برای آخرین به روزرسانی ها و مطالب اختصاصی در مورد پوشش هوش مصنوعی پیشرو در صنعت ، به خبرنامه های روزانه و هفتگی ما بپیوندید. بیشتر بدانید

هر نسخه AI مدل به ناچار شامل نمودارهایی است که نشان می دهد چگونه از رقبای خود در این آزمون معیار یا ماتریس ارزیابی بهتر عمل می کند.

با این حال ، این معیارها اغلب برای قابلیت های عمومی آزمایش می کنند. برای سازمانهایی که می خواهند از مدل ها و عوامل مبتنی بر مدل بزرگ زبان استفاده کنند ، ارزیابی چگونگی عملکرد عامل یا مدل در واقع نیازهای خاص آنها را درک می کند.

Model Repository Bugging Face Yourbench را راه اندازی کرد ، ابزاری با منبع باز که در آن توسعه دهندگان و شرکت ها می توانند معیارهای خود را برای آزمایش عملکرد مدل در برابر داده های داخلی خود ایجاد کنند.

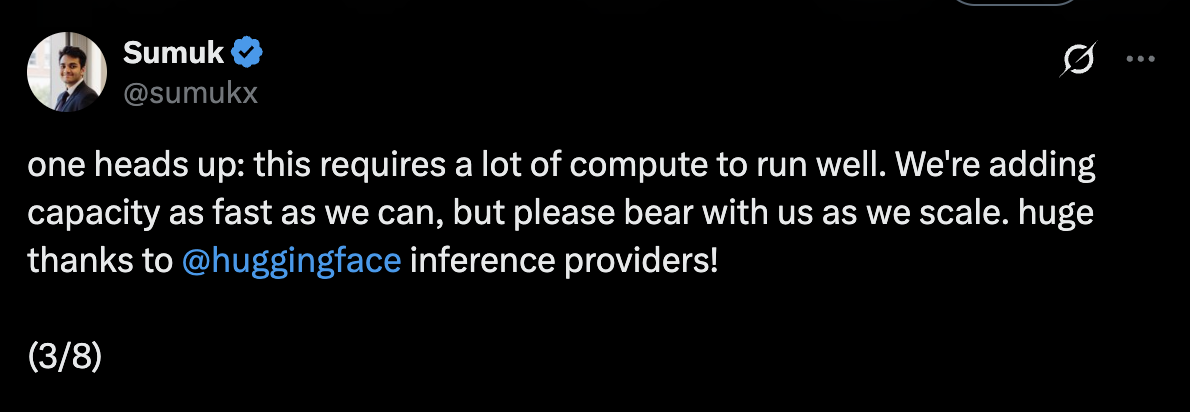

Sumuk Shashidhar ، بخشی از تیم تحقیقاتی ارزیابی ها در Hugging Face ، Yourbench را در X اعلام کرد. این ویژگی “معیار سفارشی و تولید داده های مصنوعی را از هر یک از اسناد شما ارائه می دهد. این یک گام بزرگ در جهت بهبود نحوه ارزیابی مدل است.”

وی افزود: بغل کردن چهره می داند: “برای بسیاری از موارد استفاده از آنچه واقعاً مهم است این است که یک مدل کار خاص شما را انجام می دهد. Yourbench به شما امکان می دهد مدلهایی را در مورد آنچه برای شما مهم است ارزیابی کنید.”

ایجاد ارزیابی های سفارشی

بغل کردن چهره در مقاله ای گفت که Yourbench با تکرار زیر مجموعه های معیار عظیم درک زبان چند وظیفه ای (MMLU) “استفاده از حداقل متن منبع ، دستیابی به این کار با قیمت کمتر از 15 دلار در کل استنباط در حالی که کاملاً حفظ رتبه های عملکرد مدل نسبی است.”

سازمانها قبل از اینکه بتوانند کار خود را انجام دهند ، باید اسناد خود را از قبل پردازش کنند. این شامل سه مرحله است:

- مصرف سند برای “عادی سازی” قالب های پرونده.

- تکه معنایی برای تجزیه اسناد برای برآورده کردن محدودیت های پنجره زمینه و توجه مدل.

- خلاصه اسناد

مرحله بعدی فرآیند تولید سوال و پاسخ ، که سؤالاتی از اطلاعات مربوط به اسناد ایجاد می کند. این جایی است که کاربر LLM خود را انتخاب می کند تا ببیند کدام یک به سؤالات بهترین پاسخ می دهد.

بغل کردن صورت خود را با مدل های Deepseek V3 و R1 آزمایش کرد ، مدل های Qwen Alibaba از جمله مدل استدلال QWEN QWQ ، MISTRAL LAGE 2411 و MISTRAL 3.1 SMALL ، LLAMA 3.1 و LLAMA 3.3 ، SEMINI 2.0 FLASH ، GEMINY 2.0 FLASH LITE و GEMMA 3 ، GPT-4O ، GPT-4O-MINI 3.5 هایکو.

شاشیدار گفت: بغل کردن چهره همچنین تجزیه و تحلیل هزینه را در مدل ها ارائه می دهد و دریافت که Flash Qwen و Gemini 2.0 “ارزش فوق العاده ای را برای هزینه های بسیار کم تولید می کند.”

محدودیت ها

با این حال ، ایجاد معیارهای LLM سفارشی بر اساس اسناد سازمان با هزینه ای همراه است. Yourbench برای کار به قدرت محاسبات زیادی نیاز دارد. شاشیدار در X گفت که این شرکت به همان سرعتی که می تواند “ظرفیت اضافه کردن” را اضافه می کند.

بغل کردن Face چندین GPU و شرکای خود را با شرکت هایی مانند Google برای استفاده از خدمات ابری خود برای کارهای استنتاج اجرا می کند. VentureBeat به بغل کردن چهره در مورد استفاده از محاسبات Yourbench رسید.

معیار کامل نیست

معیارها و سایر روشهای ارزیابی این ایده را به کاربران می دهند که چگونه مدل ها عملکرد خوبی دارند ، اما اینها به طور کامل نحوه عملکرد مدل ها را به طور کامل ضبط نمی کنند.

برخی حتی از شک و تردید ابراز کرده اند که تست های معیار محدودیت مدل ها را نشان می دهند و می توانند منجر به نتیجه گیری های دروغین در مورد ایمنی و عملکرد آنها شوند. یک مطالعه همچنین هشدار داد که عوامل معیار می توانند “گمراه کننده” باشند.

با این حال ، شرکت ها نمی توانند از ارزیابی مدل ها در حال حاضر که گزینه های زیادی در بازار وجود دارد ، خودداری کنند و رهبران فناوری افزایش هزینه های استفاده از مدل های هوش مصنوعی را توجیه می کنند. این امر به روشهای مختلفی برای آزمایش عملکرد و قابلیت اطمینان مدل منجر شده است.

Google DeepMind حقایق را معرفی کرد ، که توانایی یک مدل را در تولید پاسخ های دقیق و واقعی بر اساس اطلاعات مربوط به اسناد آزمایش می کند. برخی از محققان دانشگاه Yale و Tsinghua معیارهای کد خودکشی را برای راهنمایی شرکت هایی که برنامه نویسی LLM برای آنها کار می کند ، ایجاد کردند.

ارسال پاسخ