به گزارش بخش موبایل رسانه اخبار فناوری تک فاکس،

NVIDIA امروز به طور رسمی NVIDIA را در بازی های استنتاج در بازی (NVIGI) SDK معرفی کرده است- یک رابط یکپارچه برای توسعه دهندگان برای ارکستر استقرار مدل های AI از ابر به محیط های اجرای رایانه های محلی.

🎉 معرفی NVIDIA استنباط در بازی (NVIGI) SDK.

توسعه دهندگان بازی اکنون می توانند از NVIGI با ACE استفاده کنند تا ادغام یکپارچه استنباط AI را در بازی ها و برنامه های C ++ برای عملکرد بهینه و تأخیر فعال کنند. https: //t.co/hj0lv5esaq

– nvidiagamedev (nvidiagamedev) 20 فوریه 2025

NVIGI SDK شما را قادر می سازد استنباط AI را مستقیماً در بازی ها و برنامه های C ++ برای عملکرد و تأخیر بهینه ادغام کنید. توسعه دهندگان می توانند شخصیت های NVIDIA ACE AI را به بازی هایی با NVIGI SDK بیاورند.

nvidia در بازی استنتاج SDK

این یک مدیر استنتاج مبتنی بر افزونه GPU است که به منظور ساده سازی ادغام مدل های ACE در برنامه های بازی و تعاملی طراحی شده است. این قابلیت های زیر را ارائه می دهد-

- انعطاف پذیری افزونه: افزونه های AI (ASR ، مدل های زبان ، تعبیه) را با سهولت اضافه ، به روز و مدیریت کنید.

- DLL های بومی ویندوز: گردش کار را برای بازی ها و برنامه های C ++ ساده کنید.

- بهینه سازی GPU: برای استنباط کارآمد هوش مصنوعی در کنار وظایف ارائه ، از فناوری محاسبات (CIG) استفاده کنید.

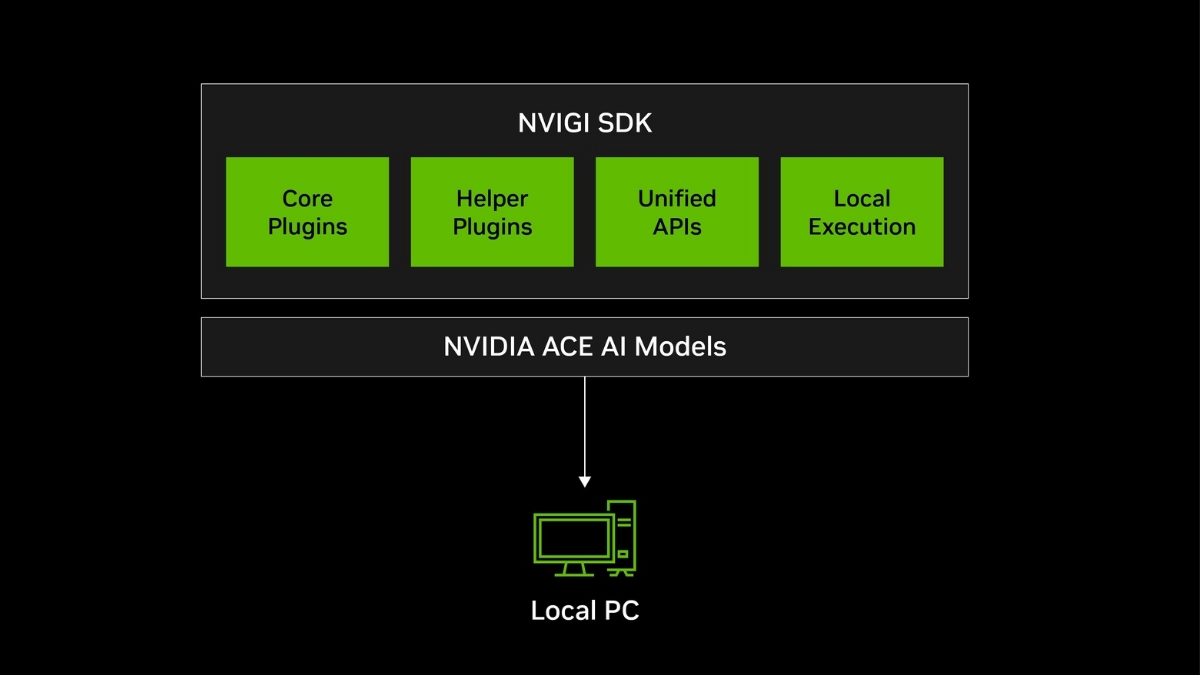

با ترکیب NVIGI با ACE ، می توانید شخصیت های خودمختار را با قابلیت های پیشرفته هوش مصنوعی مانند گفتگوی NPC در زمان واقعی ، حافظه متنی و انیمیشن مادام العمر ایجاد کنید. معماری NVIGIA ادغام انعطاف پذیر عملکردهای مختلف AI را فراهم می کند- افزونه های اصلی ، افزونه های یاور ، API های یکپارچه و اجرای محلی و ابر. این یک گردش کار عامل را تنظیم می کند و شخصیت ها را قادر می سازد در زمان واقعی گوش دهند ، دلیل ، صحبت و تحریک کنند.

برای شروع کار با استنتاج ACE در دستگاه ، کاربران باید NVIGI ، افزونه های بار و مدل ها را اولیه کنند ، پیکربندی و استنباط زمان اجرا را ایجاد کنند ، برنامه ریزی GPU و ادغام ارائه را فعال کنند و استنتاج اجرا کنند. برای کسب اطلاعات در مورد فرایند دقیق ، روی این لینک کلیک کنید.

لیست افزونه های Nvigi موجود

| افزونه nvigi | سخت افزار استنتاج پشتیبانی شده | مدلهای پشتیبانی شده |

| گفتار – GGML محلی ASR | GPU یا CPU با قابلیت CUDA | زمزمه ASR |

| گفتار – ASR محلی TRT | GPU با قابلیت CUDA | nvidia riva asr (به زودی) |

| زبان – GPT محلی ONNX DML | GPU یا CPU پشتیبانی شده از ONNX | بازپرداخت |

| زبان- GPT GGML محلی | GPU یا CPU با قابلیت CUDA | دستورالعمل Llama-5.2-3B ، Nemotron-Mini-4B-Instruct ، mistral-nemo-minitron-2b-128k-instruct ، mistral-nemo-minitron-4b-128k-instruct ، mistral-nemo-minitron-8b-128k-instruct ، NEMOVISION-4B- |

| RAG – GGML محلی را تعبیه کرد | GPU یا CPU با قابلیت CUDA | E5 بزرگ بدون نظارت |

ارسال پاسخ